Esta investigación fue realizada por el PhD José Norte Sosa, Director de

Reputación Digital. Ver más en: https://reputacion.digital

Resumen

Este estudio analiza el discurso de Elon Musk en X (Twitter) para determinar si su lenguaje está vinculado a términos asociados al nazismo o si, por el contrario, refleja una orientación democrática y liberal. Se procesaron un total de 7,010 tweets utilizando técnicas avanzadas de procesamiento de lenguaje natural (PLN), redes semánticas y visualización de datos. Se compararon términos relacionados con el nazismo con aquellos vinculados a la democracia y la libertad, aplicando un filtrado contextual. Los resultados muestran que Musk utiliza términos democráticos con mayor frecuencia que referencias al nazismo, aunque critica constantemente a los medios utilizando palabras como “propaganda”, que no necesariamente tienen una connotación nazi.

Palabras clave: Elon Musk, X (Twitter), discurso político, PLN, análisis de sentimientos, nazismo, democracia.

1. Introducción

Elon Musk es una figura influyente en los debates políticos y tecnológicos globales. Sus comentarios en redes sociales generan controversia y han sido objeto de interpretaciones polarizadas. Algunos críticos lo acusan de adoptar una retórica extremista, mientras que sus seguidores argumentan que defiende la libertad de expresión. Este estudio busca determinar si el lenguaje de Musk en X (Twitter) refleja ideologías asociadas al nazismo o si su discurso está más alineado con valores democráticos.

2. Metodología

2.1 Recolección de datos

Se analizaron un total de 7,010 tweets publicados por Elon Musk, extraídos del 1 de enero de 2024 al 31 de enero de 2025. El conjunto de datos fue procesado para eliminar ruido y estandarizar el contenido.

2.2 Procesamiento de Lenguaje Natural (PLN)

Se aplicaron técnicas de PLN para:

- Tokenización y limpieza del texto.

- Extracción de palabras clave.

- Análisis de contexto utilizando ventanas de palabras.

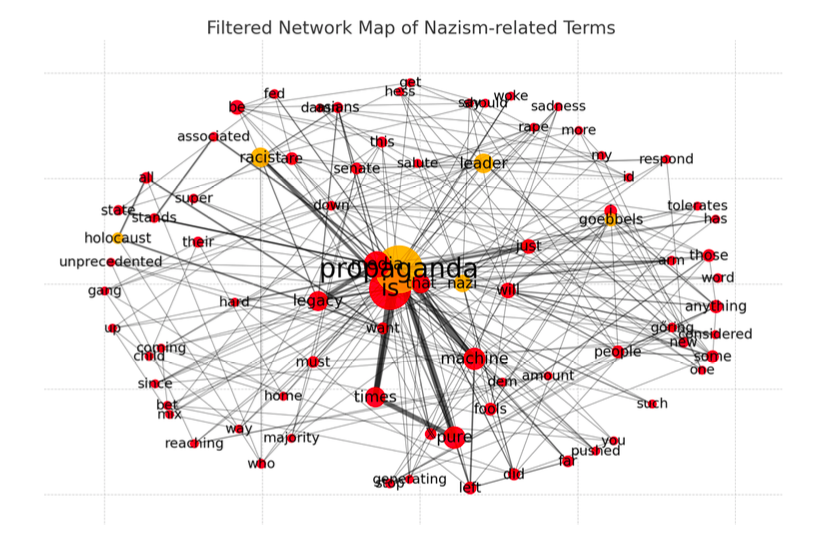

2.3 Redes semánticas

Se construyeron grafos de conexión para identificar cómo se relacionan las palabras en el discurso de Musk.

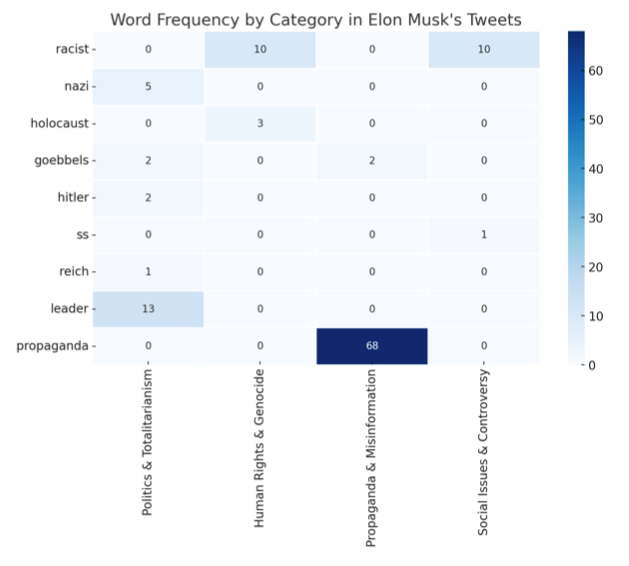

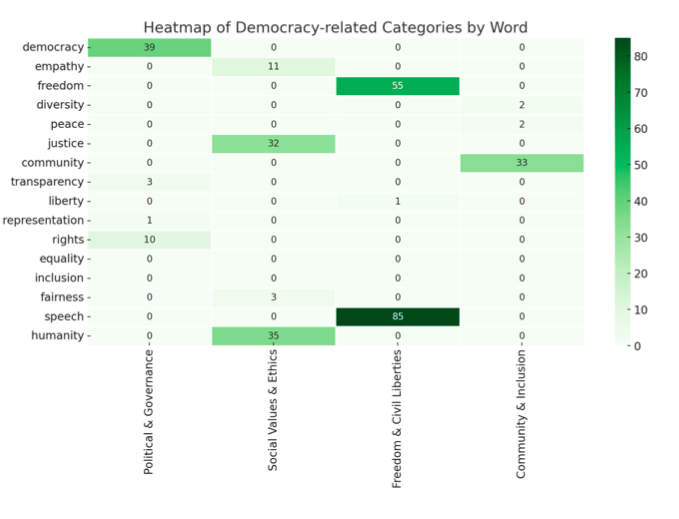

2.4 Mapas de calor y matrices cruzadas

Se generaron mapas de calor para visualizar la intensidad de los términos relacionados con el nazismo y la democracia.

2.5 Filtrado de contexto

El término “propaganda” fue analizado minuciosamente y eliminado cuando se usó fuera de un contexto histórico o político.

3. Resultados

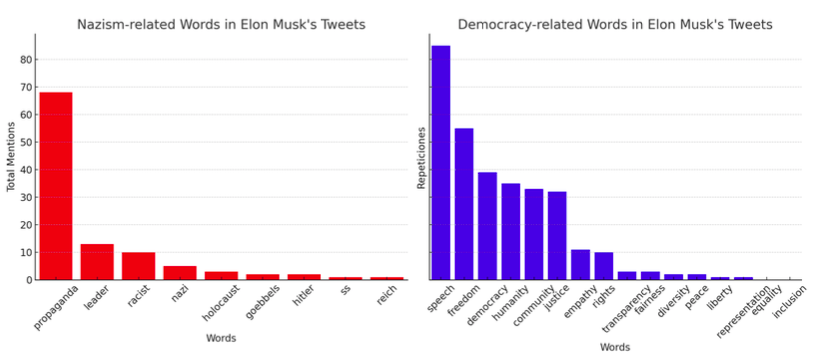

3.1 Frecuencia de términos relacionados con el nazismo

- Total de menciones ajustadas: 105.

- Palabras más utilizadas:

o “Propaganda” (68 veces). o “Leader” (13 veces).

o “Racist” (10 veces).

o “Nazi” (5 veces).o “Holocaust” (3 veces). o “Goebbels” (2 veces). o “Hitler” (2 veces).

o “SS” (1 vez).

o “Reich” (1 vez).

3.2 Frecuencia de términos relacionados con democracia y libertad

- Total de menciones: 312.

- Palabras más utilizadas:

o “Speech” (85 veces).

o “Freedom” (55 veces).

o “Democracy” (39 veces).

o “Humanity” (35 veces).

o “Community” (33 veces).

o “Justice” (32 veces).

o “Empathy” (11 veces).

o “Rights” (10 veces).

o “Transparency” (3 veces).

o “Fairness” (3 veces).

o “Diversity” (2 veces).

o “Peace” (2 veces).

o “Liberty” (1 vez).

o “Representation” (1 vez).

3.3 Comparación de uso de términos

- Los términos democráticos fueron tres veces más frecuentes que los términos relacionados con el nazismo.

- Musk utiliza “propaganda” principalmente para criticar a los medios, no en un contexto totalitario.

- El término “holocaust” fue utilizado en referencia a la humanidad en general.

3.4 Matrices cruzadas y mapas de calor

Las visualizaciones en red y los mapas de calor muestran que las palabras democráticas tienen mayor presencia y conectividad en su discurso.

Figura 1: Comparación de menciones de términos relacionados con el nazismo y la democracia.

Figura 2: Mapa de calor de términos relacionados con el nazismo.

Figura 3: Mapa de calor de términos relacionados con la democracia.

4. Discusión

Los resultados sugieren que Elon Musk no tiene un discurso alineado con el nazismo. Aunque ha utilizado palabras como “Nazi” o “Holocaust,” su contexto no implica apoyo a estas ideologías. En cambio, su lenguaje enfatiza la libertad, la democracia y la crítica a los medios de comunicación.

Sus principales intereses giran en torno a la tecnología, la libertad de expresión y la crítica mediática. Sin embargo, su uso del término “propaganda” para describir a los medios podría generar confusión. Esto destaca la importancia de analizar el contexto semántico antes de sacar conclusiones.

5. Conclusiones y limitaciones 5.1 Conclusiones

- No hay evidencia de que Musk use sistemáticamente un lenguaje relacionado con el nazismo.

- Su discurso está más enfocado en valores democráticos y crítica a los medios.

- “Propaganda” se usa en un contexto mediático, no totalitario.

5.2 Limitaciones del estudio

- Sesgo en la selección de datos: Solo se analizaron los tweets de Musk, sin considerar respuestas o menciones.

- Ironía y sarcasmo: El análisis de PLN puede no captar completamente el uso de ironía.

- Falta de contexto externo: No se consideraron eventos externos o entrevistas.

- Representatividad: El discurso en X (Twitter) puede no reflejar completamentesu postura en otros foros.

- 6. Referencias Bibliográficas

- Jurafsky, D., & Martin, J. H. (2021). Speech and Language Processing. Pearson.

- Loper, E., & Bird, S. (2002). NLTK: The Natural Language Toolkit.

- Manning, C. D., Raghavan, P., & Schütze, H. (2008). Introduction toInformation Retrieval. Cambridge University Press.

- X (Twitter) API Documentation (2024).

- Blei, D. M., Ng, A. Y., & Jordan, M. I. (2003). Latent Dirichlet Allocation.Journal of Machine Learning Research.

- Mikolov, T., Sutskever, I., Chen, K., Corrado, G. S., & Dean, J.(2013). Distributed Representations of Words and Phrases and TheirCompositionality. Advances in Neural Information Processing Systems.

- Pennington, J., Socher, R., & Manning, C. (2014). GloVe: Global Vectors forWord Representation. Empirical Methods in Natural Language Processing(EMNLP).

- Waseem, Z., & Hovy, D. (2016). Hateful Speech Detection on X (Twitter):Challenges and Solutions. Proceedings of the 10th International Conference onWeb and Social Media (ICWSM).

- Davidson, T., Warmsley, D., Macy, M., & Weber, I. (2017). Automated HateSpeech Detection and the Problem of Offensive Language. Proceedings of the11th International Conference on Web and Social Media (ICWSM).

- Schmidt, A., & Wiegand, M. (2017). A Survey on Hate Speech Detection Using Natural Language Processing. Proceedings of the 5th International Workshop onNatural Language Processing for Social Media.